数据处理与存储服务 数字时代的基石与引擎

在当今这个信息爆炸的时代,数据已超越石油,成为驱动社会进步与经济发展的核心生产要素。数据处理与存储服务,作为支撑这一数字生态的底层基础设施,正日益凸显其不可或缺的战略价值。它们不仅是信息得以保存、流动和应用的物理基础,更是激发创新、优化决策、提升效率的关键引擎。

一、数据处理服务:从原始信息到智慧洞见

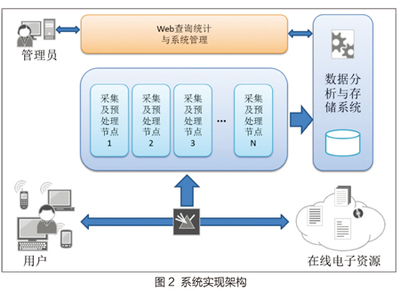

数据处理服务涵盖了从数据采集、清洗、整合、分析到可视化的全链路。原始数据往往杂乱无章、充满噪声,数据处理的第一个关键步骤便是通过清洗与标准化,去除无效和错误信息,形成高质量、结构化的数据集。通过整合来自不同源头的数据,打破“信息孤岛”,形成更全面的数据视图。

数据分析是价值提炼的核心环节。借助机器学习、人工智能、统计分析等技术,服务提供商能够帮助企业和机构从海量数据中挖掘出隐藏的模式、趋势和关联。无论是精准的用户画像、供应链的优化预测,还是潜在风险的智能预警,都依赖于强大的数据处理能力。通过可视化工具,将复杂的分析结果转化为直观的图表和报告,赋能各层级决策者。

二、数据存储服务:安全、可靠、弹性的数字仓库

如果说数据处理是“精炼厂”,那么数据存储就是“战略储备库”。数据存储服务已经从早期的本地硬盘、磁带库,发展到如今主流的云存储、分布式存储等形态。其核心要求可归纳为三点:

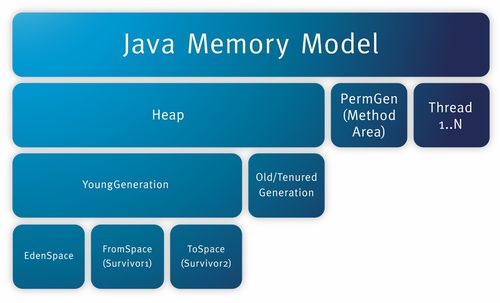

- 可靠性(Reliability)与持久性(Durability):通过多副本、纠删码、跨地域冗余等技术,确保数据在任何硬件故障或局部灾难下都不会丢失,实现极高的数据持久性(如99.999999999%)。

- 安全性(Security):提供从网络传输加密、静态数据加密到精细化的访问控制(IAM)、审计日志等全方位安全防护,满足日益严格的法规合规要求(如GDPR,中国的网络安全法与数据安全法)。

- 可扩展性(Scalability)与成本效益:云存储服务尤其突出,能够实现存储容量的弹性伸缩,用户无需预置硬件,按实际使用量付费。通过冷、热、温等分层存储策略,在性能与成本之间取得最佳平衡。

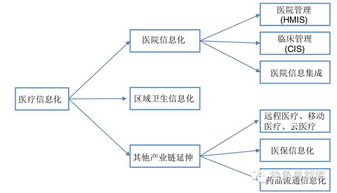

三、融合趋势:一体化的数据服务栈

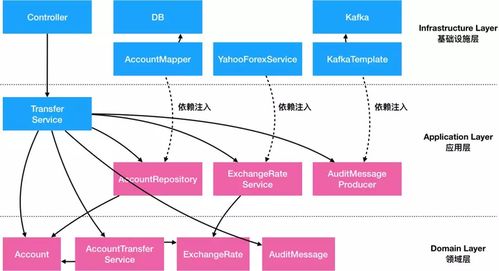

当前,数据处理与存储服务的边界正日益模糊,呈现出深度集成的趋势。各大云服务商(如AWS, Azure, 阿里云, 腾讯云)及专业服务商,都提供了从存储、计算到分析的一体化平台。例如,数据湖(Data Lake)架构允许将原始数据以原生格式集中存储,然后按需调用计算资源进行处理分析,实现了存储与计算的解耦,极大提升了灵活性和资源利用率。

“数据库即服务”(DBaaS)、“数据仓库即服务”(DWaaS)以及新兴的“湖仓一体”(Lakehouse)模式,都在试图提供更无缝、更智能的数据管理体验,降低企业构建和维护数据基础设施的技术门槛与成本。

四、面临的挑战与未来展望

尽管前景广阔,该领域也面临诸多挑战:数据隐私与伦理问题日益突出;跨域、跨境的数据流动面临复杂的合规壁垒;爆炸式增长的数据量对能耗和可持续性提出考验;以及对实时处理能力(流处理)的更高要求。

数据处理与存储服务将朝着更智能、更自动化、更安全可信的方向演进。边缘计算将与云端协同,满足物联网等场景的低延迟需求;隐私计算技术(如联邦学习、安全多方计算)将在保护数据隐私的前提下实现价值流通;人工智能将更深地嵌入数据管理全生命周期,实现自优化、自修复。

###

数据处理与存储服务,作为数字经济的基石,其发展水平直接关系到社会智能化转型的深度与广度。无论是企业寻求数字化转型,还是科研机构探索未知,抑或是公共服务提升效能,都离不开强大、可信、高效的数据服务支撑。持续创新并应对挑战,构建更加完善的数据服务生态,将是释放数据要素潜能、共创智慧未来的关键所在。

如若转载,请注明出处:http://www.ad-bdd.com/product/81.html

更新时间:2026-06-03 13:05:18